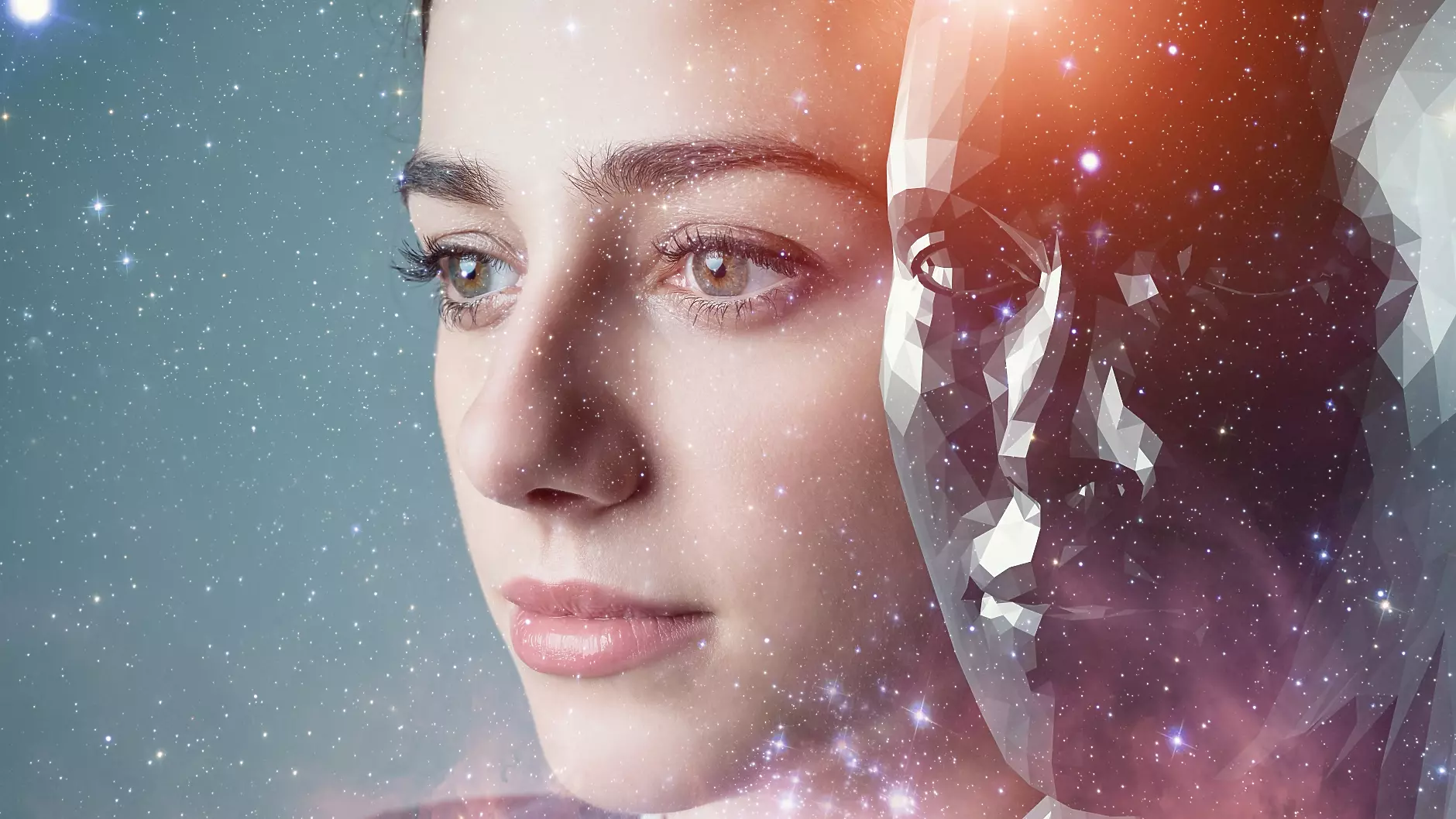

Роботи с чувства?

Хората традиционно претендират за надмощие над машините, когато става въпрос за разбиране на емоциите. Това обаче ще бъде така само за известно време напред.

На фона на преобладаващата подозрителност относно роботите, които нахлуват в човешките емоции, експертите, работещи върху емоционален изкуствен интелект, известен също като емоционален AI или афективно изчисление, смятат, че сме на път към тази нова реалност.

Нашето взаимодействие със съвременните технологии става все по-сложно. В резултат на това, тъй като AI става все по-интегриран в живота ни, търсенето на емоционална интелигентност е по-силно от всякога. Ето защо разчитаме на него повече от всякога. Тази социална промяна, активирана от AI, значително ще повлияе на начина, по който управляваме нашите емоции и взаимодействия с клиенти. По-задълбочените познания за емоционалната интелигентност в бизнеса стават все по-жизненоважни. Те ни помагат да управляваме използването на изкуствен интелект в бизнеса и да управляваме усилията си да създадем по-ефективно и пълноценно общуване.

Какво точно е Emotional AI?

Терминът Emotion AI не се отнася до компютър, който плаче, защото е имал трудна седмица. Това е област на изкуствения интелект, разработена за пръв път през 1995 г. за анализиране, разбиране и дори дублиране на човешки емоции. Техниката има за цел да подобри естествената комуникация човек-машина, за да създаде AI, който комуникира по-автентично. Ако AI може да научи емоционална интелигентност, той може също да имитира тези емоции.

Днес емоционалният изкуствен интелект вече се използва в различни сфери като бизнеса и здравеопазването за пазарни проучвания и потребителски нагласи, както и за набиране на персонал и психологически оценки и консултации. Има много изследвания за възможността за създаване на AI системи, които могат да разпознават и реагират на емоции. Един подход към задачата е да се използват алгоритми за машинно обучение, за да се анализират израженията на лицето, тона на гласа и други знаци, за да се определи емоционалното състояние на човек.

Например, изследователите са разработили алгоритми, които могат да анализират изражението на лицето, за да определят дали човек е щастлив, тъжен, ядосан или неутрален. След това тези алгоритми могат да се използват за създаване на системи, които могат да разпознават и реагират на тези емоции в реално време.

Друг подход за създаване на емоционално интелигентни AI системи е използването на изкуствени невронни мрежи, които са предназначени да имитират начина, по който работи човешкият мозък. Тези мрежи могат да бъдат обучени да разпознават и реагират на различни емоции, като се захранват с големи количества данни и коригират вътрешните си връзки, за да разпознават по-добре модели.

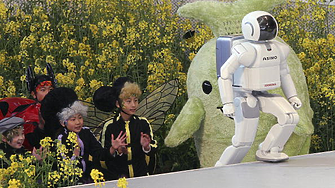

Има и редица компании и изследователи, които работят върху създаването на роботи, които са способни да изразяват и разпознават емоции. Тези роботи често използват изражения на лицето, език на тялото и други сигнали, за да предадат емоционалното си състояние на хората.

Какви са тенденциите за 2023 г.?

През 2023 г. емоционалният AI – технология, която може да усеща и взаимодейства с човешките емоции – ще се превърне в едно от доминиращите приложения на машинното обучение. Например Hume AI, основан от бившия изследовател на Google Алън Коуен, разработва инструменти за измерване на емоции от вербални, лицеви и гласови изражения. Шведската компания Smart Eyes наскоро придоби Affectiva - компания, която се отдели от MIT Media Lab и разработи невронната мрежа SoundNet. Това е алгоритъм, който класифицира емоции като гняв от аудио проби за по-малко от 1,2 секунди. Дори видео платформата Zoom въвежда Zoom IQ: функция, която скоро ще предостави на потребителите анализ в реално време на емоциите и ангажираността по време на виртуална среща.

През 2023 г. технологичните компании ще пуснат усъвършенствани чатботове, които могат точно да имитират човешките емоции, за да създадат по-съпричастни връзки с потребителите в банкирането, образованието и здравеопазването. Чатботът Xiaoice на Microsoft вече е успешен в Китай, като обикновените потребители съобщават, че са разговаряли с „него“ повече от 60 пъти за един месец. Той също така премина теста на Тюринг, като потребителите не успяха да го разпознаят като бот в продължение на 10 минути общуване. Анализ от Juniper Research Consultancy показва, че взаимодействията с чатботове в здравеопазването ще нараснат с почти 167 процента от 2018 г., за да достигнат 2,8 милиарда годишни взаимодействия през 2023 г. Това ще освободи време на медицинския персонал и потенциално ще спести около 3,7 милиарда долара за системите на здравеопазване по света.

През 2023 г. емоционалният изкуствен интелект също ще стане често срещан в училищата. В Хонконг някои средни училища вече използват програма за изкуствен интелект, разработена от Find Solutions AI, която измерва микродвиженията на мускулите по лицата на учениците и идентифицира набор от отрицателни и положителни емоции. Учителите използват тази система, за да проследяват емоционалните промени в учениците, както и тяхната мотивация и фокус, което им позволява да предприемат ранни интервенции, ако ученикът губи интерес към материята.

Роботи с чувства

Предвид човешката природа, добрите чувства могат да се разпространят от положителните емоционални изрази на човешкия събеседник към клиента/пациента и същото може да се случи с чатбот, задвижван от AI. Но понякога тези добри чувства се анулират от негативна реакция на това, че не се очаква чатботовете да показват емоции и хората се стрсяскат от това. Очакванията играят важна роля за това дали AI чатбот, изразяващ положителни емоции, всъщност е положително или отрицателно преживяване. Различните типове клиенти ще реагират по различен начин на едни и същи емоции, изразени от AI.

Друга част от проблема се крие в това, че по-голямата част от емоционалния AI се основава на погрешна наука. Алгоритмите за емоционален изкуствен интелект, дори когато са обучени на големи и разнообразни набори от данни, свеждат изражението на лицето и тона до емоция, без да

отчитат социалния и културен контекст на човека и ситуацията. Докато, например, алгоритмите могат да разпознаят и докладват, че човек плаче, не винаги е възможно точно да се изведе причината и значението зад сълзите. По същия начин, намръщеното лице не означава непременно ядосан човек, но това е заключението, до което един алгоритъм вероятно ще стигне. Защо? Ние всички адаптираме нашите емоционални прояви според нашите социални и културни норми, така че нашите изражения не винаги са вярно отражение на нашите вътрешни състояния. Често хората извършват „емоционални усилия“, за да прикрият истинските си емоции, и начинът, по който те изразяват емоциите си, вероятно е заучена реакция, а не спонтанно изразяване. Например, жените често променят емоциите си повече от мъжете, особено тези, които имат отрицателни стойности, приписани им като например гняв, защото се очаква да го направят.

Като такива, AI технологиите, които правят предположения за емоционалните състояния, вероятно ще изострят половите и расовите неравенства в нашето общество. Например, доклад на ЮНЕСКО от 2019 г. показа вредното въздействие на определянето на пола на технологиите за изкуствен интелект с „женски“ системи за гласови асистенти, проектирани според стереотипите за емоционална пасивност и изпълнителност.

AI за разпознаване на лица може също така да стандартизира расовите неравенства. Анализът от 400 баскетболни мача от календара на NBA с две популярни софтуерни програми за разпознаване на емоции, Face и Face API на Microsoft, показа, че приписва средно повече негативни емоции на чернокожите играчи, дори когато се усмихват. Тези резултати потвърждават други изследвания, които показват, че чернокожите мъже трябва да излъчват повече положителни емоции на работното място, тъй като са стереотипни като агресивни и заплашителни.

Емоционалните AI технологии ще станат все по-широко разпространени през 2023 г., но ако бъдат оставени безспорни и непроверени, те ще засилят системните расови и полови пристрастия, ще повторят и акцентират върху неравенствата в различните общества по света и ще поставят в неравностойно положение онези, които вече са маргинализирани. Ето защо е необходимо компаниите и институциите внимателно да проверяват ефективността и полезността на подобни технологии, преди да се впуснат сляпо в тяхното прилагане.

Ключови думи

ОЩЕ ОТ КАТЕГОРИЯТА

|

|

Коментари

Няма въведени кометари.