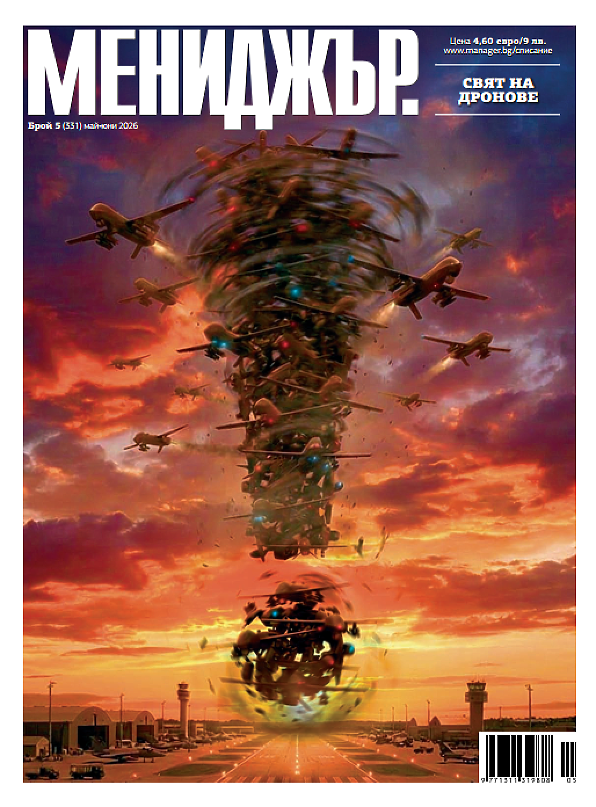

Експерти: Практиките за безопасност на AI компаниите не отговарят на глобалните стандарти

Практиките за безопасност на водещи компании в областта на изкуствения интелект, като Anthropic, OpenAI, xAI и Meta, са „далеч под нововъзникващите глобални стандарти“, според новото издание на индекса за безопасност на AI на Future of Life Institute, публикувано в сряда и цитирано от Ройтерс.

Институтът заяви, че оценката за безопасност, извършена от независим панел от експерти, е установила, че докато компаниите се надпреварват да разработват суперинтелигентни системи, нито една няма солидна стратегия за контрол на подобни напреднали технологии.

Проучването идва на фона на засилена обществена загриженост относно въздействието върху обществото на системи, по-умни от хората, способни на разсъждение и логическо мислене, след няколко случая на самоубийства и самонаранявания, свързани с AI чатботове.

„Въпреки скорошния шум около хакерски атаки с помощта на AI и случаи, в които AI доведе хора до психоза и самонараняване, американските AI компании остават по-слабо регулирани от ресторантите и продължават да лобират срещу задължителни стандарти за безопасност“, каза Макс Тегмарк, професор в MIT и президент на Future of Life.

Надпреварата в AI не показва признаци на забавяне, като големите технологични компании инвестират стотици милиарди долари в обновяване и разширяване на усилията си в машинното обучение.

Future of Life Institute е неправителствена организация, която повдига въпроси за рисковете, които интелигентните машини представляват за човечеството. Основана през 2014 г., тя получи ранна подкрепа от изпълнителния директор на Tesla Илон Мъск.

През октомври група, включваща учени като Джефри Хинтън и Йошуа Бенджио, призова за забрана на разработването на суперинтелигентен изкуствен интелект, докато обществото не го поиска и науката не намери безопасен път напред.

ОЩЕ ОТ КАТЕГОРИЯТА

|

|

Коментари

Няма въведени кометари.