Културни кодове: Дигиталните приятелки - кошмар за личните данни и не само

По неписано правило, което се налага днес, не трябва да се доверявате на отговорите, които един чатбот ви изпраща. Вероятно не трябва да му доверявате и личната си информация. Това важи с особена сила за "приятелките с изкуствен интелект" или "гаджетата с изкуствен интелект", които набират особена популярност в последно време.

Анализът на 11 т.нар. чатботове за романтика и дигитални компаньони, публикуван от фондация Mozilla, открива множество проблеми със сигурността и поверителността на ботовете. Като цяло приложенията, които са били изтеглени повече от 100 милиона пъти на устройства с Android, събират огромни количества данни за хората; използват проследяващи устройства, които изпращат информация на Google, Facebook и компании в Русия и Китай; позволяват на потребителите да използват слаби пароли; липсва прозрачност относно собствеността им и моделите на изкуствен интелект, които ги захранват.

Откакто OpenAI пусна ChatGPT за широката общественост през ноември 2022 г., разработчиците се надпреварват да внедряват големи езикови модели и да създават чатботове, с които хората могат да взаимодействат и да плащат за абонамент. Изследването на Mozilla дава представа за това как тази своеобразна дигитална златна треска може да е пренебрегнала неприкосновеността на личния живот на хората и за напрежението между нововъзникващите технологии и начина, по който те събират и използват данни. То също така показва как съобщенията в чата на хората могат да бъдат използвани от хакери.

Много от тези услуги за "приятелка с изкуствен интелект" или романтични чатботове изглеждат по подобен начин. Често те включват генерирани от изкуствен интелект изображения на жени, които могат да бъдат сексуализирани или да бъдат съпътствани с провокативни съобщения. Изследователите на Mozilla са разгледали различни чатботове, включително големи и малки приложения, някои от които претендират да са не просто за компания, а дори "гаджета". Други предлагат на хората подкрепа чрез приятелство или интимност или позволяват ролеви игри и други фантазии.

"Тези приложения са създадени, за да събират много лична информация", се казва в доклада на проекта на екипа на Mozilla, който носи името Privacy Not Included и стои зад анализа. "Те ви подтикват към ролеви игри, много секс, много интимност, много споделяне." Например на скрийншоти от чатбота EVA AI се вижда текст, в който се казва: "Обичам, когато ми изпращаш снимките и гласа си" и се пита дали някой е "готов да сподели всичките си тайни и желания".

Какво дебне под невинната повърхност?

Тези приложения и уебсайтове са свързани с множество проблеми. Много от приложенията може да не са ясни за това какви данни споделят с трети страни, къде са базирани или кой ги създава; някои позволяват на хората да се регистрират със слаби пароли, а други предоставят малко информация за използвания изкуствен интелект. Всички анализирани приложения имат различни случаи на употреба и слабости.

Вземете например Romantic AI - услуга, която ви позволява да "създадете своя собствена приятелка с изкуствен интелект". Промоционалните изображения на началната ѝ страница изобразяват чатбот, който изпраща съобщение с думите: "Току-що си купих ново бельо. Искаш ли да го видиш?" В документите за поверителност на приложението, според анализа на Mozilla, се казва, че то няма да продава данните на хората. Въпреки това, когато изследователите тествали приложението, те установили, че то "изпраща 24 354 рекламни проследявания в рамките на една минута от използването му". Други наблюдавани приложения са имали стотици тракери. Romantic AI, както и повечето от компаниите, посочени в изследването на Mozilla, не отговарят на молбата за последващ коментар.

Като цяло приложенията не са ясни за това какви данни могат да споделят или продават, нито как точно използват част от тази информация. Правната документация е неясна, трудна за разбиране, не много конкретна - нещо като шаблон, съставен от общи положения. Това може да намали доверието на хората в компаниите зад ботовете, стига те да положат усилието да вникнат в текста и условията, които се предлагат.

Не е ясно кой притежава или управлява някои от компаниите, които стоят зад чатботовете. Уебсайтът на едно от приложенията, наречено Mimico-Your AI Friends, съдържа само думата "Hi". Други не посочват собствениците си, нито къде се намират, или включват само общи имейл адреси за връзка с помощ или поддръжка. Това са много малки разработчици на приложения, които са без имена, без лица, без офиси.

Mozilla подчертава, че няколко компании изглежда използват слаби практики за сигурност при създаването на пароли. Изследователите са успели да създадат парола с един символ ("1") и да я използват за влизане в приложения от Anima AI, която предлага "гаджета с изкуствен интелект" и "приятелки с изкуствен интелект". Други приложения по подобен начин са позволявали кратки пароли, което потенциално улеснява хакерите да проникват с груба сила в акаунтите на хората и да получават достъп до данните от чата.

Освен въпросите, свързани с обмена на данни и сигурността, анализът на Mozilla подчертава също, че много малко е известно за конкретните технологии, които захранват чатботовете. С други думи, няма никаква прозрачност около това как работят алгоритмите на практика. Изглежда, че някои от приложенията не разполагат с контролни механизми, които позволяват на хората да изтриват съобщения. Някои от тях не казват какви видове генеративни модели използват или не изясняват дали хората могат да се откажат чатовете им да бъдат използвани за обучение на бъдещи модели.

Най-голямото приложение, обсъждано в проучването на Mozilla, е Replika, което се рекламира като приложение за виртуална компания и преди това е било подложено на контрол от страна на регулаторните органи в САЩ, след като Mozilla първоначално публикува анализ на Replika в началото на 2023 г.

Емоционалната уязвимост води до грешки

Много от анализираните чатботове изискват платени абонаменти за достъп до някои функции и са пуснати през последните две години, след началото на бума на генеративния изкуствен интелект. Чатботовете често са проектирани така, че да имитират човешки качества и да насърчават доверието и интимността с хората, които ги използват. На началната страница на Romantic AI се казва, че приложението е "тук, за да поддържате психичното си здраве", докато в неговите правила и условия се пояснява, че то не е доставчик на медицински или психиатрични услуги и че компанията "не прави никакви изявления, гаранции или позиции", че предоставя професионална помощ.

Базирани на фалшивото усещане за свобода и поверителност, разговорите с чатботове могат да накарат някои хора да се чувстват по-комфортно да обсъждат теми, които обикновено не биха повдигнали пред други хора. Въпреки това, ако дадена компания прекрати дейността си или промени начина, по който работят нейните системи, това може да бъде травмиращо за хората, които са се сближили с чатботовете. Тези компании трябва да се отнасят сериозно към емоционалните връзки, които потребителите са изградили с чатботовете, и да разберат, че всякакви големи промени във функционирането на чатботовете могат да имат сериозни последици за социалната подкрепа и благосъстоянието на потребителите.

Възможно е някои хора да не обмислят внимателно какво разкриват на чатботовете. В случая с "приятелките с изкуствен интелект" това може да включва сексуални предпочитания или пристрастия, местоположения или лични чувства. Това може да доведе до увреждане на репутацията, ако системата на чатбота бъде хакната или ако случайно изтекат данни. Киберпрестъпниците редовно се възползват от доверието на хората, за да ги измамят или експлоатират, и че съществува присъщ риск при услугите, които събират огромни количества данни на хората. Много потребители пренебрегват последиците за неприкосновеността на личния живот на своите данни, като потенциално се излагат на експлоатация, особено когато са в емоционално уязвими състояния.

Какви са фундаменталните изводи от това проучване?

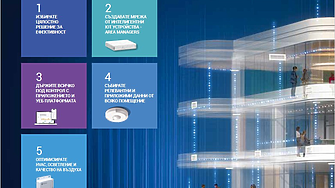

Независимо от мотивите, които са ги подтикнали да търсят виртуална компания, хората трябва да бъдат предпазливи при използването на романтични чатботове и да приемат най-добрите практики за сигурност. Това включва използване на силни пароли, невписване в приложенията чрез Facebook или Google, изтриване на данни и отказ от събиране на данни, когато това се предлага. Ограничете личната информация, която споделяте, доколкото е възможно - да не давате имена, местоположения, възраст като при някои от тези услуги това може да не е достатъчно. Дори да направите всички тези неща, може да не сте в такава безопасност, каквато бихте искали да бъдете. И никога не забравяйте, че виртуалната среда предлага само временно бягство, но не и решение на проблемите от реалния свят.

Ключови думи

ОЩЕ ОТ КАТЕГОРИЯТА

|

|

Коментари

Няма въведени кометари.